2026年4月9日 | 预计阅读时间:12分钟

2026年的科技圈,最大的看点莫过于AI从“动嘴”向“动手”的全面进化。如果说过去三年是AI的“大脑进化期”,那么2026年,则被业界公认为AI真正接管桌面的 “Agent元年” -11。在这场变革中,AI桌面助手成为各大科技巨头竞相布局的核心赛道——从Anthropic推出的Claude Cowork,到阿里的QoderWork、字节跳动的UI-TARS-desktop,再到腾讯的WorkBuddy,一场桌面级的AI入口争夺战已全面打响--8-11-30。

面对层出不穷的产品和术语,许多技术学习者陷入困惑:AI桌面助手究竟如何工作?它凭什么能“看见”我的桌面、听懂我的指令并执行操作?传统自动化工具和AI驱动的桌面助手到底有什么区别?本文将从零开始,带你系统拆解AI桌面助手的核心技术原理,辅以代码示例和面试要点,帮你建立完整的知识链路。

本文导读:先用一个痛点场景说明AI桌面助手为何必要→深入拆解“感知-理解-执行”三层核心架构→对比传统自动化工具的差异→提供可运行的极简代码示例→解析底层支撑技术→提炼高频面试题→最后总结知识图谱。

痛点切入:当自动化工具遇到“人肉”操作

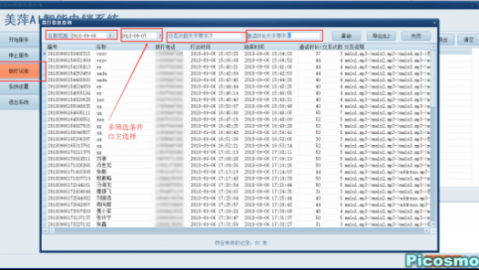

先看一个真实场景。假设你需要收集某个网站上的动态数据,传统做法通常是:手动打开浏览器、定位元素、复制粘贴到Excel……周而复始。有人会说:“写个自动化脚本不就行了?”

但真正写过自动化脚本的人都知道痛点在哪里。以PyAutoGUI为例:

import pyautogui import time 传统坐标脚本自动化 time.sleep(3) 给你时间切换到目标窗口 pyautogui.click(850, 450) 点击框,坐标写死 pyautogui.write("某网站") 输入文本 pyautogui.press('enter') time.sleep(2) pyautogui.click(950, 320) 点击第一个结果,又是固定坐标

这段脚本暴露了传统自动化方案的致命缺陷:

坐标依赖:窗口位置一变、屏幕分辨率一改,脚本立刻失效

无视觉感知:脚本不知道界面上有什么,只能“盲点”

无法理解上下文:遇到弹窗、加载状态变化时,脚本无法自适应

维护成本高:UI界面稍作调整,整个脚本可能就要重写

更不要说跨应用协同了——要让脚本在浏览器里查完数据、在Excel里生成图表、再通过邮件发送出去,不同应用之间的切换和数据流转,复杂度成倍增长。这正是AI桌面助手出现的根本原因:它要让AI像人一样“看懂”电脑界面,用自然语言代替硬编码指令。

核心概念讲解:桌面智能体

AI桌面助手,英文全称为AI Desktop Assistant,也可称为桌面级智能体(Desktop Agent)。它是一种能够通过自然语言与用户交互,具备感知、理解并自主操作桌面操作系统能力的AI应用。

拆解这个定义中的三个关键词:

感知(Perception) :AI桌面助手能够通过屏幕捕获技术“看见”当前桌面上有什么——打开的窗口、显示的文本、按钮的位置、输入框的状态等。

理解(Understanding) :基于大语言模型,它能够解析用户的自然语言指令,理解用户的真实意图,并将其转化为可执行的操作序列。

操作(Action) :通过模拟鼠标、键盘等系统级输入,它能够像人类一样完成点击、输入、拖拽、滚动等操作,真正“动手”执行任务。

生活化类比:AI桌面助手就像一个坐在你电脑旁的“数字实习生”。你只需口头告诉他“帮我把下载文件夹里的图片按日期整理好”,他就能自己盯着屏幕,找到“下载”文件夹,识别哪些是图片文件,按日期重命名并移动到对应的子文件夹里。你不需要教他“先点这里、再点那里”——他自己会看、会想、会做。

AI桌面助手的核心价值在于:将操作复杂度从用户端转移到AI处理端,让用户从繁琐的执行层工作中解放出来,专注于更有价值的决策和创造-8。

关联概念讲解:视觉语言模型

理解了“桌面智能体”是什么,还需要了解它是如何“看见”桌面的。这里必须引入另一个核心技术概念:视觉语言模型(Vision-Language Model, VLM) 。

VLM是一种能够同时处理图像和文本的多模态AI模型。传统的LLM只能理解文字,而VLM在此基础上增加了“看懂图像”的能力——给定一张屏幕截图,VLM可以识别出图中包含哪些UI元素、它们的位置关系、以及这些元素的语义含义。

VLM与AI桌面助手的关系可以这样理解:

| 维度 | AI桌面助手 | VLM |

|---|---|---|

| 角色定位 | 应用层产品,面向用户 | 底层能力,面向开发者 |

| 核心能力 | 感知→理解→执行全流程 | 仅完成视觉理解这一环节 |

| 依赖关系 | 依赖VLM提供视觉理解能力 | 被AI桌面助手调用 |

| 类比 | 一位实习生 | 这位实习生的“眼睛” |

以字节跳动开源的UI-TARS-desktop为例,其核心技术正是VLM——通过截图+视觉语言模型,理解当前桌面上正在发生什么,再根据自然语言指令执行自动化操作-。系统采用“感知-理解-执行”三层架构,完美融合了计算机视觉与NLP的前沿技术-8。

一句话记住:AI桌面助手是“大脑+手脚”,VLM是“眼睛”;没有眼睛,大脑就无法看见桌面。

概念关系与区别总结

经过上面的拆解,可以清晰地理清几个关键概念之间的关系:

AI桌面助手 = 大语言模型(大脑) + 视觉语言模型(眼睛) + 系统执行器(手脚)

具体来说:

感知层:由VLM负责,对屏幕截图进行视觉解析,识别UI元素

理解层:由LLM负责,解析自然语言指令,规划操作步骤

执行层:通过系统API或模拟输入实现操作落地

相比传统自动化工具(如按键精灵、PyAutoGUI),AI桌面助手的核心突破在于从“坐标驱动”到“意图驱动”的范式跃迁:

| 对比维度 | 传统自动化工具 | AI桌面助手 |

|---|---|---|

| 操作依据 | 固定坐标/元素选择器 | 视觉理解+语义推理 |

| 输入方式 | 编写脚本 | 自然语言 |

| 跨应用能力 | 极弱,需人工衔接 | 强,自主切换窗口 |

| 抗界面变化 | 极差 | 较好,视觉元素识别 |

| 适用门槛 | 需要编程能力 | 零门槛,人人可用 |

代码示例:一个极简的桌面智能体核心逻辑

下面是一个极简的Python示例,展示AI桌面助手的核心工作流程(以模拟实现为例,实际生产级产品使用成熟VLM和LLM):

import pyautogui import time from PIL import Image import base64 import requests class SimpleDesktopAgent: """极简桌面智能体演示""" def __init__(self, llm_api_url, vlm_api_url): self.llm_api = llm_api_url LLM接口 self.vlm_api = vlm_api_url VLM接口 def capture_screen(self): """步骤1:感知——捕获屏幕""" screenshot = pyautogui.screenshot() return screenshot def understand_screen(self, screenshot, user_command): """步骤2:理解——VLM解析界面 + LLM解析指令""" 将截图转为base64 buffered = BytesIO() screenshot.save(buffered, format="PNG") img_base64 = base64.b64encode(buffered.getvalue()).decode() VLM识别界面元素 vlm_prompt = "识别这张截图中所有可点击的UI元素,返回名称和位置" vlm_response = requests.post(self.vlm_api, json={"image": img_base64, "prompt": vlm_prompt}) ui_elements = vlm_response.json()["elements"] 返回类似 {"框": (850, 450), ...} LLM将用户指令转化为操作序列 llm_prompt = f"用户指令:{user_command}。可用UI元素:{ui_elements}。请输出操作序列" llm_response = requests.post(self.llm_api, json={"prompt": llm_prompt}) action_sequence = llm_response.json()["actions"] 返回 [{"action": "click", "target": "框"}, ...] return action_sequence def execute(self, action_sequence): """步骤3:执行——调用系统API执行操作""" for action in action_sequence: if action["action"] == "click": target = action["target"] 如 "框" 实际需将元素名映射为坐标,此处简化为模拟 pyautogui.click(850, 450) 点击坐标 elif action["action"] == "type": pyautogui.write(action["content"]) elif action["action"] == "press": pyautogui.press(action["key"]) time.sleep(0.5) 等待界面响应 def run(self, user_command): """主流程""" screenshot = self.capture_screen() 感知:看 actions = self.understand_screen(screenshot, user_command) 理解:想 self.execute(actions) 执行:做 使用示例 agent = SimpleDesktopAgent("https://api.llm.com", "https://api.vlm.com") agent.run("帮我在浏览器里‘2026年AI趋势’并打开第一个结果")

关键步骤解读:

capture_screen() :调用

pyautogui.screenshot()获取屏幕像素数据,这是感知层的起点understand_screen() :VLM识别UI元素名称和位置,LLM将自然语言指令翻译为具体的操作序列

execute() :通过

pyautogui模拟鼠标点击和键盘输入,完成物理操作

新旧对比:传统脚本需要硬编码坐标(pyautogui.click(850, 450)),界面一变就失效;而AI桌面助手通过VLM动态识别元素位置,无论窗口如何移动,都能找到正确的目标。当用户说“点框”时,它知道“框”对应屏幕上哪个坐标,实现了从硬编码到语义理解的飞跃。

底层原理与技术支撑

AI桌面助手的能力并非凭空而来,其背后依赖三大底层技术支柱:

1. 计算机视觉与UI元素识别

VLM能够识别屏幕上的UI元素,依赖的是视觉Transformer架构和目标检测算法。屏幕内容被逐帧分析,每个控件(按钮、输入框、菜单)被检测并标注边界框,再通过语义模型赋予含义-20。实验数据显示,先进的界面解析架构可将复杂业务场景下的信息提取准确率从传统方案的58%提升至89%-20。

2. 大语言模型的指令分解与规划

LLM在此承担“总指挥”角色。用户说“整理下载文件夹”,LLM需要自动分解为:打开资源管理器 → 定位下载文件夹 → 遍历文件 → 按类型分类 → 移动到对应子目录 → 通知用户完成。这种链式推理能力源于LLM在海量文本上学到的“任务规划”知识。

3. 跨平台系统操作API

执行层的实现依赖操作系统底层的输入模拟机制。在Windows上,这涉及SendInput、mouse_event等Win32 API;在macOS上,则依赖CGEvent等Core Graphics框架。AI桌面助手通过封装这些API,实现对鼠标、键盘、剪贴板、窗口管理等的统一控制-22。

企业级产品还引入了安全沙箱和零信任架构,确保AI执行敏感操作时不会造成数据泄露。测试数据显示,安全沙箱方案可阻断99.7%的恶意软件攻击-2。

💡 进阶预告:关于VLM的训练与微调、LLM任务规划的工程实现、安全沙箱的完整架构,将在后续系列文章中逐一展开。

高频面试题与参考答案

以下整理了AI桌面助手领域的5道高频面试题,建议重点掌握:

1️⃣ 请简述AI桌面助手与传统自动化脚本(如PyAutoGUI)的本质区别。

参考答案要点:

操作依据不同:传统脚本依赖固定坐标或元素选择器,界面变化即失效;AI桌面助手基于视觉理解,动态识别UI元素。

输入方式不同:传统脚本需编写代码,有技术门槛;AI桌面助手支持自然语言交互,人人可用。

适应性不同:传统脚本面对弹窗、加载等动态变化无法自适应;AI桌面助手可结合上下文推理调整策略。

跨应用能力不同:传统脚本跨应用需手动衔接;AI桌面助手可自主切换窗口,完成跨应用协同任务。

💡 踩分点:答出“坐标驱动 vs 意图驱动”这一核心范式差异最为关键。

2️⃣ 解释AI桌面助手“感知-理解-执行”三层架构,每层分别由什么技术实现?

参考答案要点:

感知层:由视觉语言模型(VLM)实现,对屏幕截图进行视觉解析,识别UI元素的位置和语义。

理解层:由大语言模型(LLM)实现,解析自然语言指令,将其转化为结构化的操作序列。

执行层:通过系统API(如Win32 API、Core Graphics)或模拟输入工具(如PyAutoGUI)实现鼠标、键盘等操作落地。

💡 踩分点:必须明确指出三层各自对应的技术组件,最好能举例说明。

3️⃣ 为什么传统OCR+规则引擎方案不适用于复杂的桌面智能体场景?

参考答案要点:

识别率低:OCR对动态界面元素的识别率不足60%,无法处理嵌套界面和自定义控件。

缺乏语义理解:只能识别文字,无法理解界面元素之间的逻辑关系(如“关闭按钮在标题栏右上角”)。

多语言支持弱:对中英混合、多语言切换场景适应性差,准确率低于45%。

无法处理动态内容:对实时数据仪表板、动画效果等动态界面无能为力。

💡 踩分点:强调OCR的局限性在于“只能识字,不能识图”和“无法理解上下文”。

4️⃣ 实现AI桌面助手的跨应用协同,需要解决哪些技术挑战?

参考答案要点:

跨应用数据同步:不同应用的数据格式不统一,需构建统一的数据总线实现毫秒级同步。

权限与安全隔离:跨应用操作涉及敏感数据访问,需实现零信任安全模型和操作审计追踪。

应用间通信协议:不同应用API差异巨大,需通过智能代理机制统一封装认证、权限和异常处理。

流程编排与容错:多应用协同链路复杂,需支持条件分支、并行处理和异常恢复机制。

💡 踩分点:答出“数据总线、安全隔离、代理机制、流程编排”四个关键词即可获得高分。

5️⃣ 目前主流的AI桌面助手有哪些代表产品?各自的差异化特点是什么?

参考答案要点:

| 产品 | 厂商 | 差异化特点 |

|---|---|---|

| Claude Cowork | Anthropic | 最早引爆市场,深度集成Claude生态,支持一键整理桌面等场景 |

| UI-TARS-desktop | 字节跳动 | 开源,基于VLM的“感知-理解-执行”三层架构,支持本地运行 |

| QoderWork | 阿里巴巴 | 零门槛桌面Agent,内置MCP协议,支持自定义Skills扩展 |

| WorkBuddy | 腾讯 | 2026年3月发布,兼容OpenClaw生态,支持多模型并发调度 |

| 阶跃AI桌面伙伴 | 阶跃星辰 | 同时支持Win/Mac,深度融入产品经理工作流 |

💡 踩分点:列出3个以上代表性产品,并说出各自的核心卖点即可。

结尾总结

回顾全文,我们从传统自动化工具的痛点切入,拆解了AI桌面助手的核心概念,理清了它与VLM、LLM的关系,通过代码示例展示了“感知-理解-执行”三层架构的运行机制,并探讨了底层技术支撑和高频面试考点。

重点总结:

✅ AI桌面助手的本质是 “视觉感知 + 语义理解 + 系统执行” 三位一体

✅ 核心突破是从 “坐标驱动” 到 “意图驱动” 的范式跃迁

✅ 底层依赖 VLM(看见界面)、LLM(理解指令)、系统API(动手执行)

✅ 面试必考点:三层架构、与传统工具的区别、主流产品对比

易错提醒:初学者容易混淆AI桌面助手与普通语音助手(如Siri、小爱同学)——后者只能调用预设的系统功能,而前者可以自主操作任意桌面应用,自由度完全不同。

💡 预告:下一篇将深入剖析VLM的训练与微调方法,手把手教你从零训练一个可用的UI理解模型,敬请期待!

本文基于2026年4月的最新行业动态与技术资料整理,旨在为技术学习者和从业者提供系统、实用的知识参考。